Epic Games, компания, создавшая Unreal Engine, недавно выпустила существенное обновление своего инструмента для создания персонажей MetaHuman, который впервые позволяет разработчикам импортировать сканы реальных людей для использования в приложениях реального времени. Улучшения позволяют заглянуть в будущее, в котором каждый может легко перенести реалистичную цифровую версию себя в виртуальную реальность и метавселенную в целом.

Инструмент Epic MetaHuman предназначен для того, чтобы упростить разработчикам создание разнообразных высококачественных 3D-моделей персонажей для использования в приложениях реального времени. Инструмент работает как расширенная версия «настройщика персонажей», который вы найдете в современной видеоигре, за исключением того, что с гораздо большим контролем и точностью.

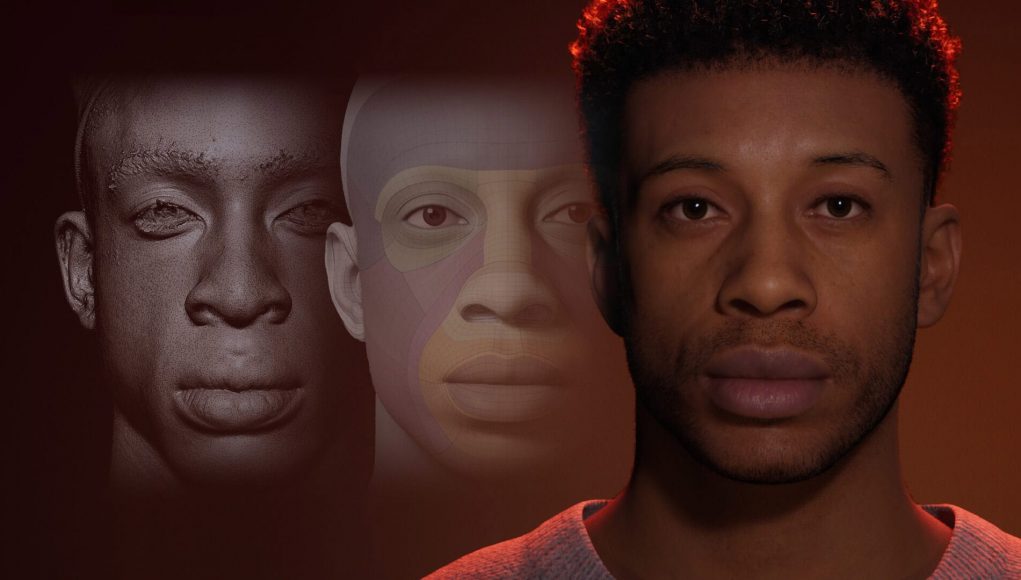

3D-персонаж, созданный с помощью MetaHuman

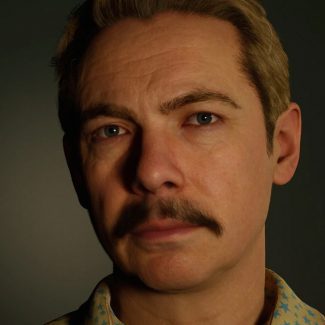

3D-персонаж, созданный с помощью MetaHuman

В его первоначальном выпуске разработчики могли начать формировать своих персонажей только из набора предустановленных лиц, а затем использовать оттуда инструменты, чтобы изменить внешний вид персонажа по своему вкусу. Естественно, многие экспериментировали, пытаясь создать собственное подобие или сходство с узнаваемыми знаменитостями. Хотя создание персонажа в MetaHuman происходит молниеносно — по сравнению с созданием сопоставимой модели вручную с нуля — достижение сходства с конкретным человеком оставалось сложной задачей.

Но теперь последняя версия включает в себя новую функцию «Mesh to MetaHuman», которая позволяет разработчикам импортировать сканы лица реальных людей (или 3D-скульпты, созданные в другом программном обеспечении), а затем система автоматически создает лицо MetaHuman на основе сканирования.

Однако есть еще некоторые ограничения. Во-первых, волосы, текстуры кожи и другие детали не генерируются автоматически; на данный момент функция Mesh to MetaHuman в первую очередь ориентирована на сопоставление общей топологии головы и ее сегментацию для реалистичной анимации. Разработчикам по-прежнему нужно будет предоставить текстуры кожи и проделать дополнительную работу, чтобы подобрать волосы, растительность на лице и глаза для человека, которому они хотят подражать.

Инструмент MetaHuman все еще находится в раннем доступе и предназначен для разработчиков Unreal Engine. И хотя мы еще не достигли той стадии, когда каждый может просто сделать несколько фотографий своей головы и создать реалистичную цифровую версию себя, совершенно ясно, что мы движемся в этом направлении.

Однако, если цель состоит в том, чтобы создать полностью правдоподобный аватар нас самих для использования в VR и метавселенной, есть проблемы, которые еще предстоит решить.

Просто создать модель, похожую на вас, недостаточно. Вам также нужна модель, чтобы двигаться, как вы.

У каждого человека есть своя уникальная мимика и манеры, которые легко узнаются людьми, хорошо их знающими. Даже если модель лица сфальсифицирована для анимации, если только она не сфальсифицирована таким образом, чтобы соответствовать вашим выражениям и не способна использовать реальные примеры ваших выражений, реалистичный аватар никогда не будет выглядеть так же, как вы, когда он находится в движении.

Для людей, которые вас не знают, это не так уж важно, потому что у них нет исходных данных о ваших выражениях лица, на которые они могли бы опираться. Но это было бы важно для ваших близких отношений, где даже небольшие изменения в обычном выражении лица и манерах человека могут указывать на целый ряд состояний, таких как рассеянность, усталость или даже пьянство.

Стремясь решить эту конкретную проблему, Meta (признана экстремистской организацией в России) работает над собственной системой под названием Codec Avatars, целью которой является анимация реалистичной модели вашего лица с полностью правдоподобной анимацией, уникальной для вас.

Возможно, в будущем мы увидим слияние таких систем, как MetaHumans и Codec Avatars; одна позволяет легко создавать реалистичный цифровой аватар, другая — анимировать этот аватар уникальным и правдоподобным образом.

Источник